Notes on Section 4.1

线性模型不总是正确的,因为并不是所有的结果都可以用其元素的值单调性的表示(比如一张照片更加像猫或者是狗,这个在我们把照片倒置之后,线性模型就会出现问题)

“我们可以通过在网络中加入一个或多个隐藏层来克服线性模型的限制。 这种架构通常称为多层感知机(multilayer perceptron),通常缩写为MLP。”

这里面新增加的层叫做“隐藏层”

“激活函数的输出(例如,)被称为活性值(activations)。 一般来说,有了激活函数,就不可能再将我们的多层感知机退化成线性模型”

激活函数,可以理解为一个非线性函数,应用在输入的所有数据上,其一般是不含权重的,所以在训练过程中不会改变。

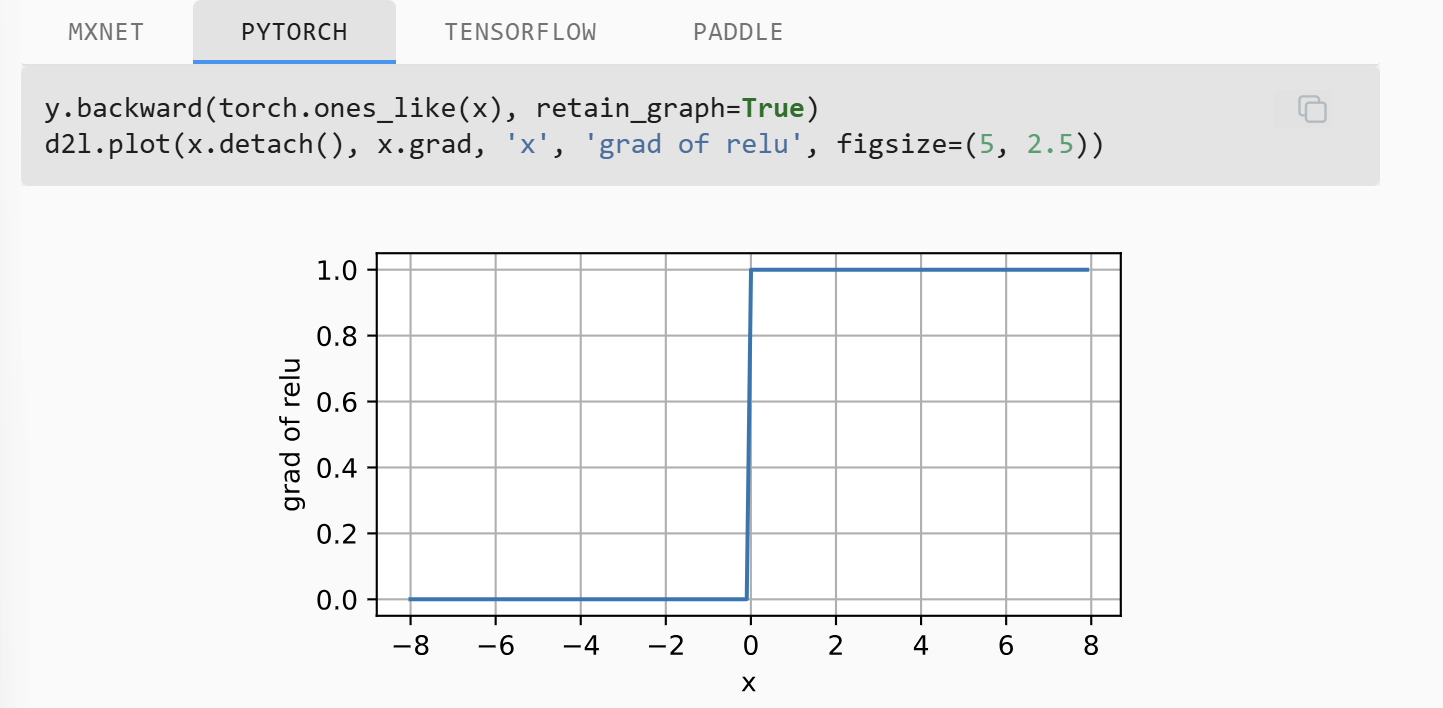

ReLU函数

“当输入为负时,ReLU函数的导数为0,而当输入为正时,ReLU函数的导数为1。 注意,当输入值精确等于0时,ReLU函数不可导。”

使用导数来定义这个函数,而不是使用逻辑判断式,是因为我们依然要使用反向传播计算梯度,不能简单的掐断传递链。

“使用ReLU的原因是,它求导表现得特别好:要么让参数消失,要么让参数通过。 这使得优化表现得更好,并且ReLU减轻了困扰以往神经网络的梯度消失问题”

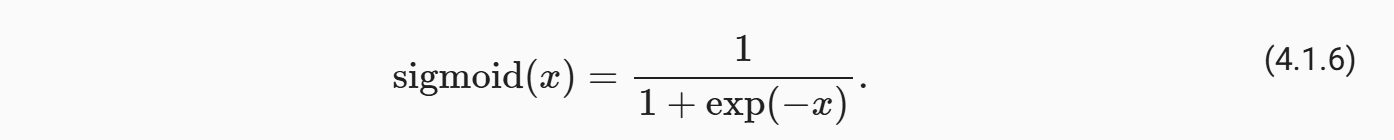

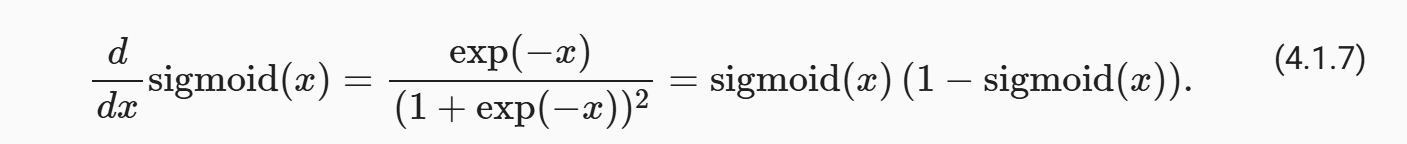

Sigmoid函数

可以观察到,这个函数将任意实数域内的一个数压缩成(0,1)内的一个数,所以这个函数也叫(squashing function)

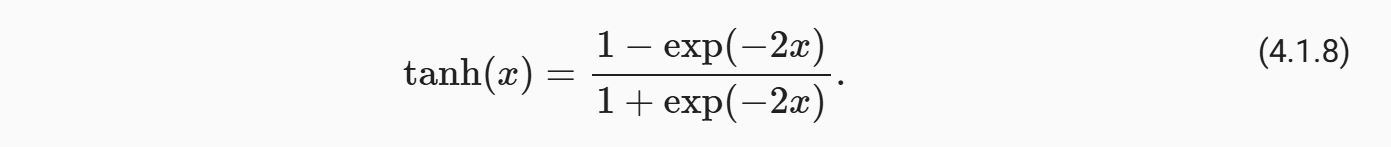

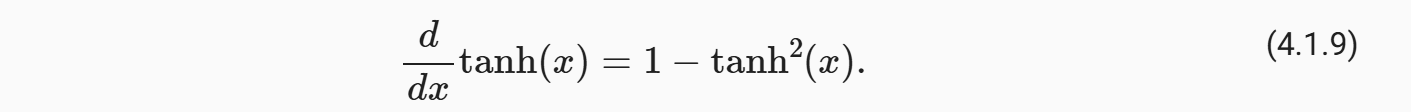

Tanh函数

双曲正切函数将其输入压缩转换到区间(-1, 1)

- Title: Notes on Section 4.1

- Author: bobown_yao

- Created at : 2025-12-20 00:00:00

- Updated at : 2026-01-17 16:18:07

- Link: https://bobownyao.github.io/2025/12/20/Notes-on-Section-4-1/

- License: All Rights Reserved © bobown_yao