Notes on Section 4.6

暂退法(dropout)

在4.5中,我们使用L2正则化,这里我们引入暂退法,其本质思想是一致的,也就是防止某一些权重过分大,从而导致在这些方向上受噪音影响大。

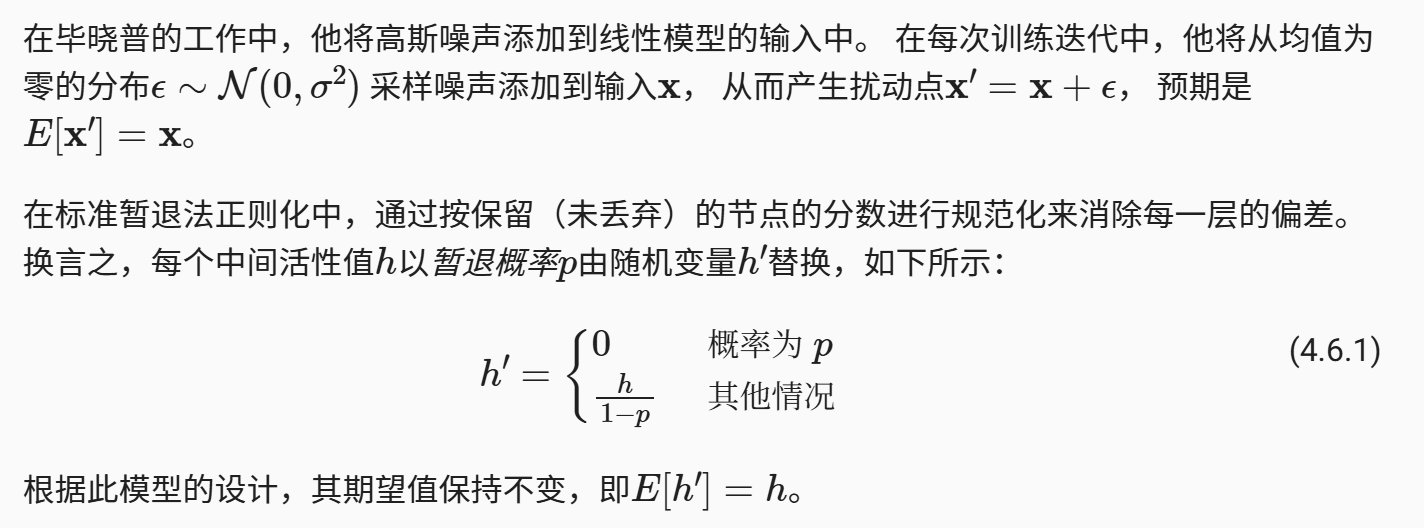

传统的理论认为,为了达到模型的泛化特性,需要使用更加简单的模型,也即更小的维度,另外一个角度是模型的平滑性,也就是在小的扰动下不会产生过于显著的晃动。

“暂退法在前向传播过程中,计算每一内部层的同时注入噪声,这已经成为训练神经网络的常用技术。 这种方法之所以被称为暂退法,因为我们从表面上看是在训练过程中丢弃(drop out)一些神经元。 在整个训练过程的每一次迭代中,标准暂退法包括在计算下一层之前将当前层中的一些节点置零。”

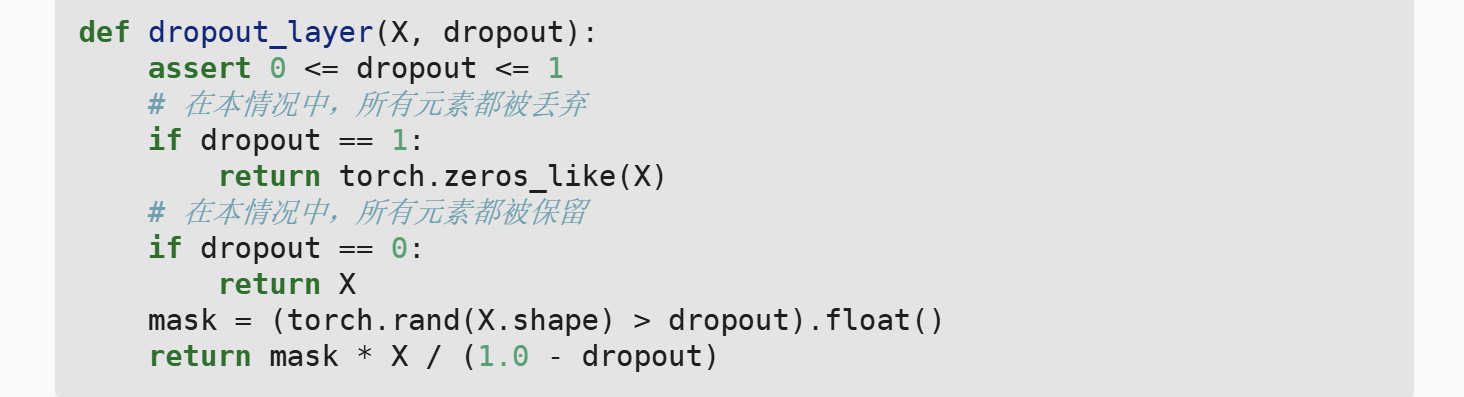

这里我们可以观察到,在舍弃之后,我们对剩余的张量进行了缩放

需要注意的是

这个算法的实现逻辑是,在单层开始前,我们均匀的从[0,1]中抽取和这层输出相同数量的样本,然后保留那些大于p的样本而舍弃其余。

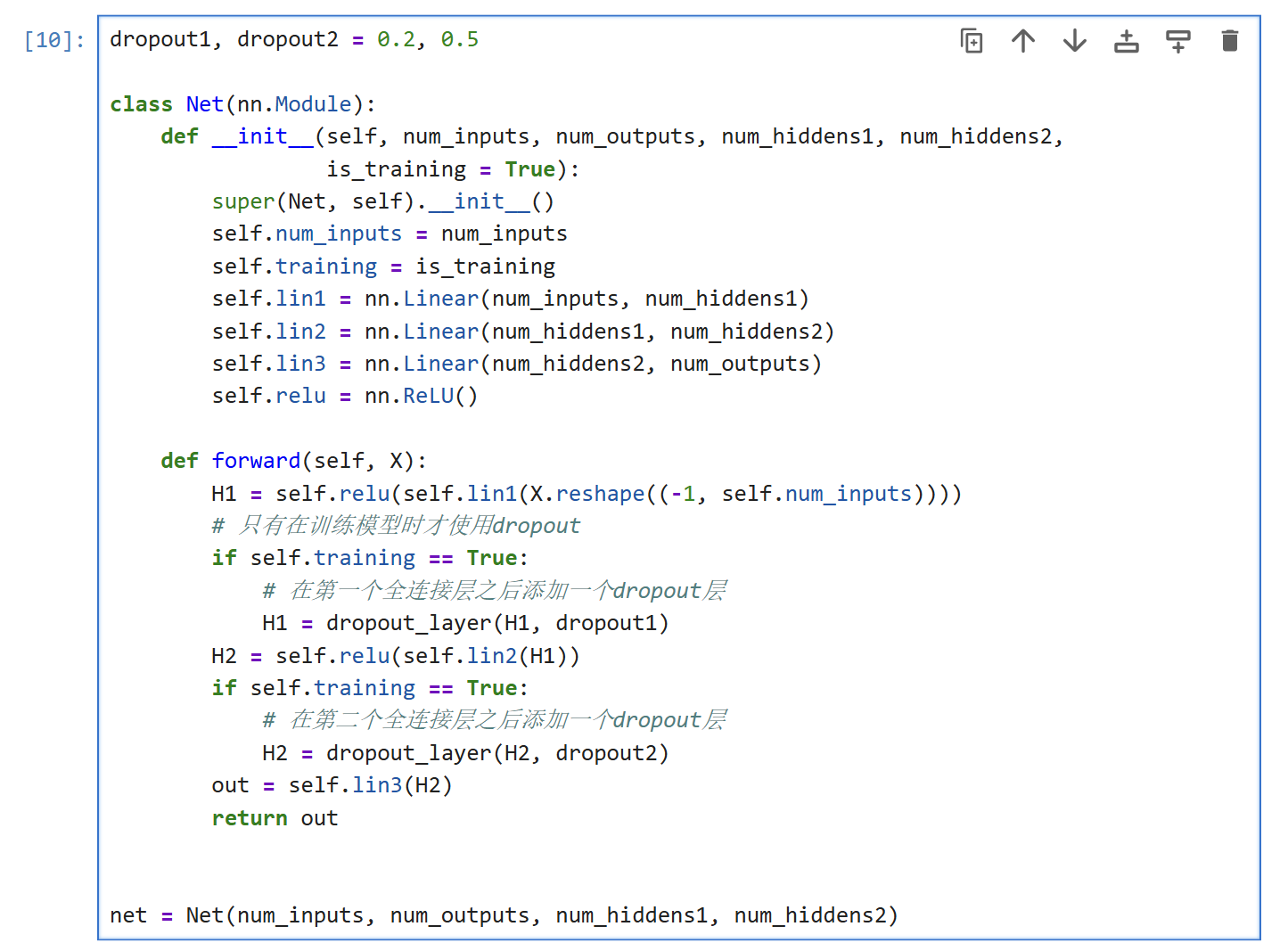

事实上dropout和ReLU函数往往是复合使用的

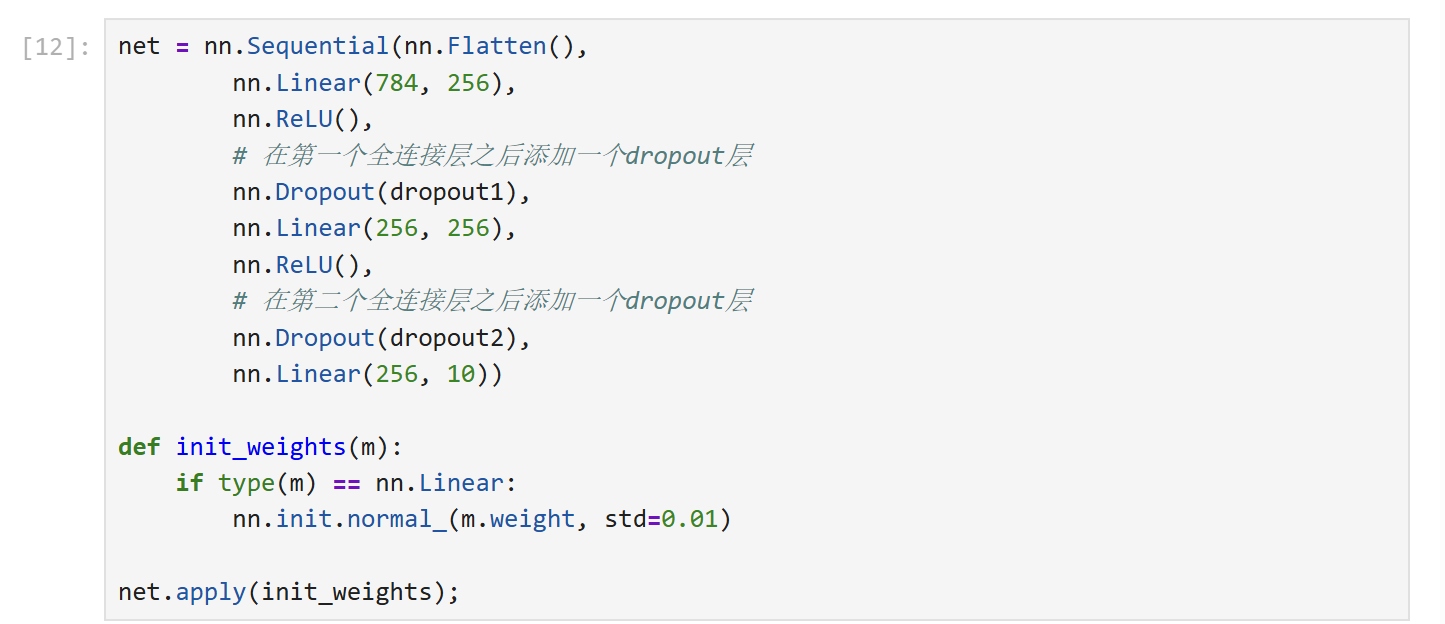

在这个例子中,使用了两次ReLU和dropout

同样的dropout也是一个已有的模板层,可以简洁实现

- Title: Notes on Section 4.6

- Author: bobown_yao

- Created at : 2025-12-27 00:00:00

- Updated at : 2026-01-17 16:18:07

- Link: https://bobownyao.github.io/2025/12/27/Notes-on-Section-4-6/

- License: All Rights Reserved © bobown_yao