Notes on Section 2.5

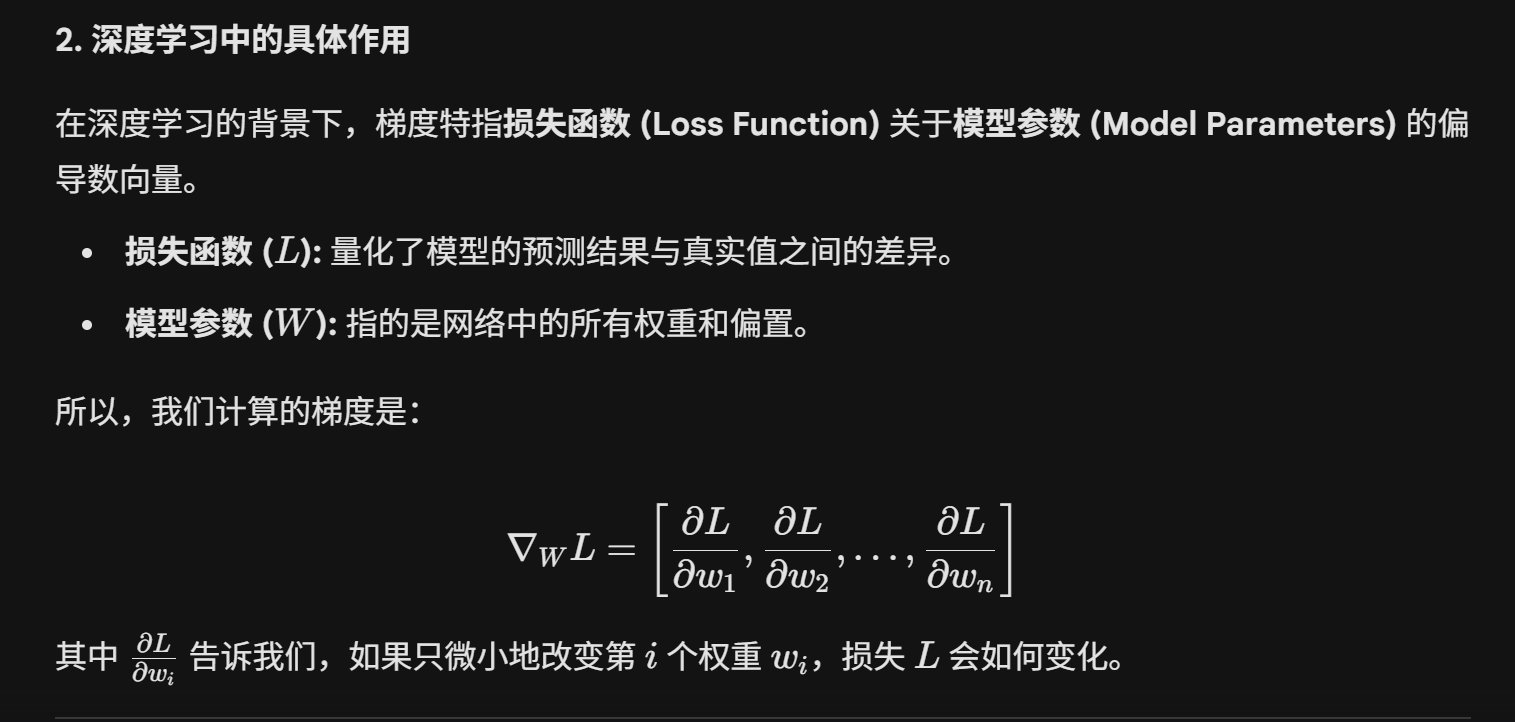

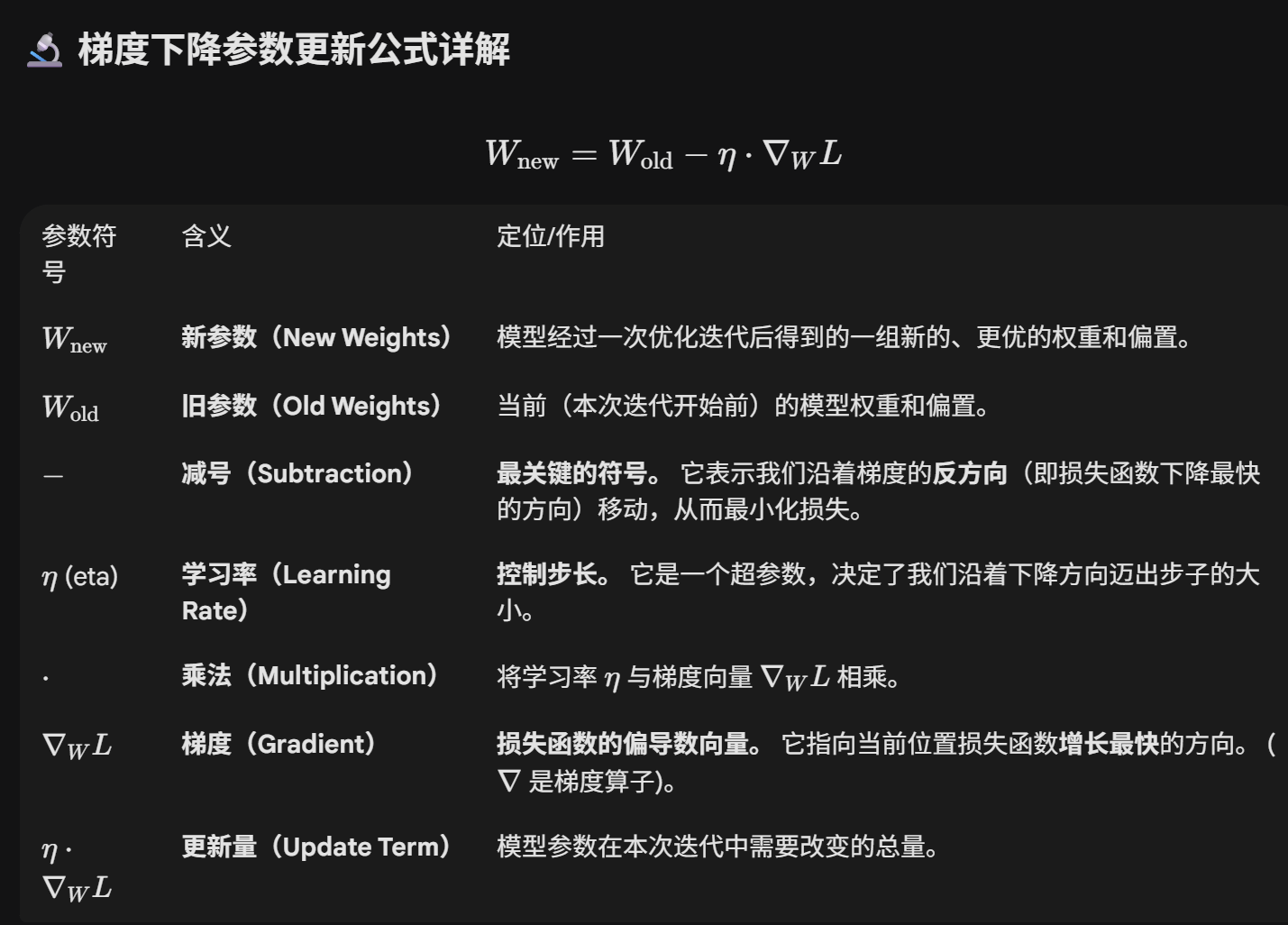

首先我们应该明确梯度在深度学习中的应用

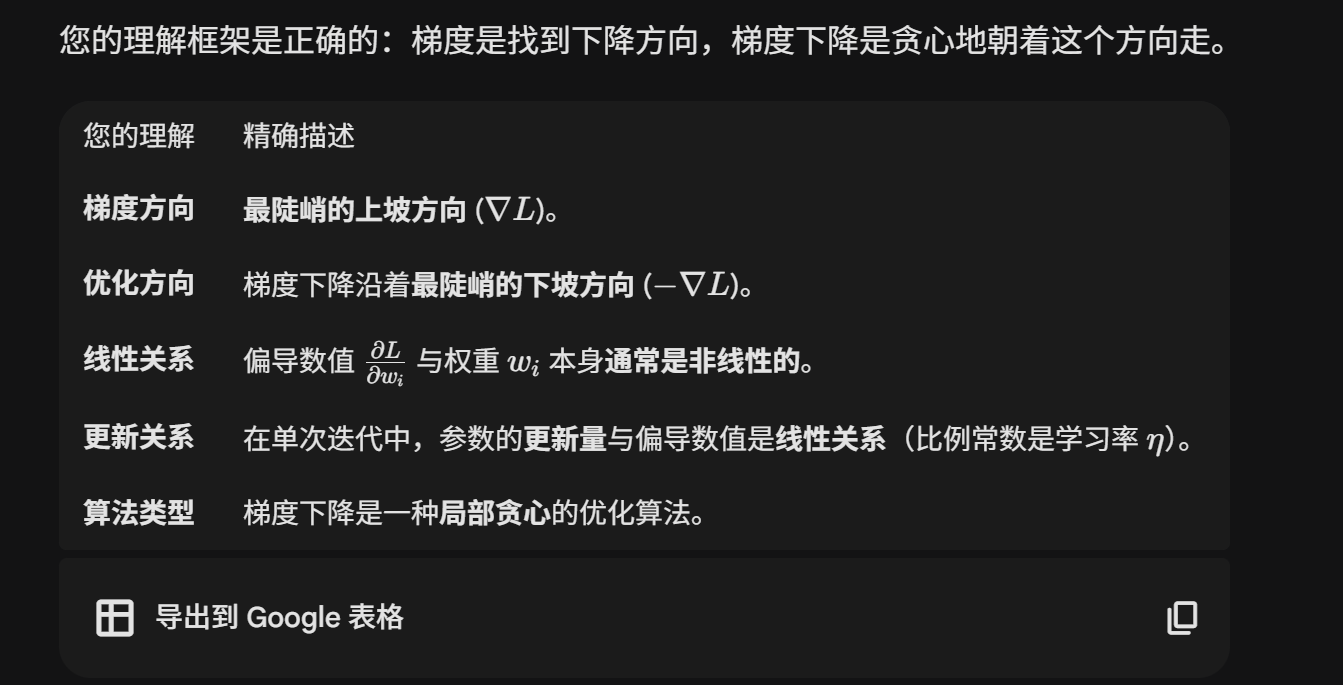

我们理解了梯度的一些概念

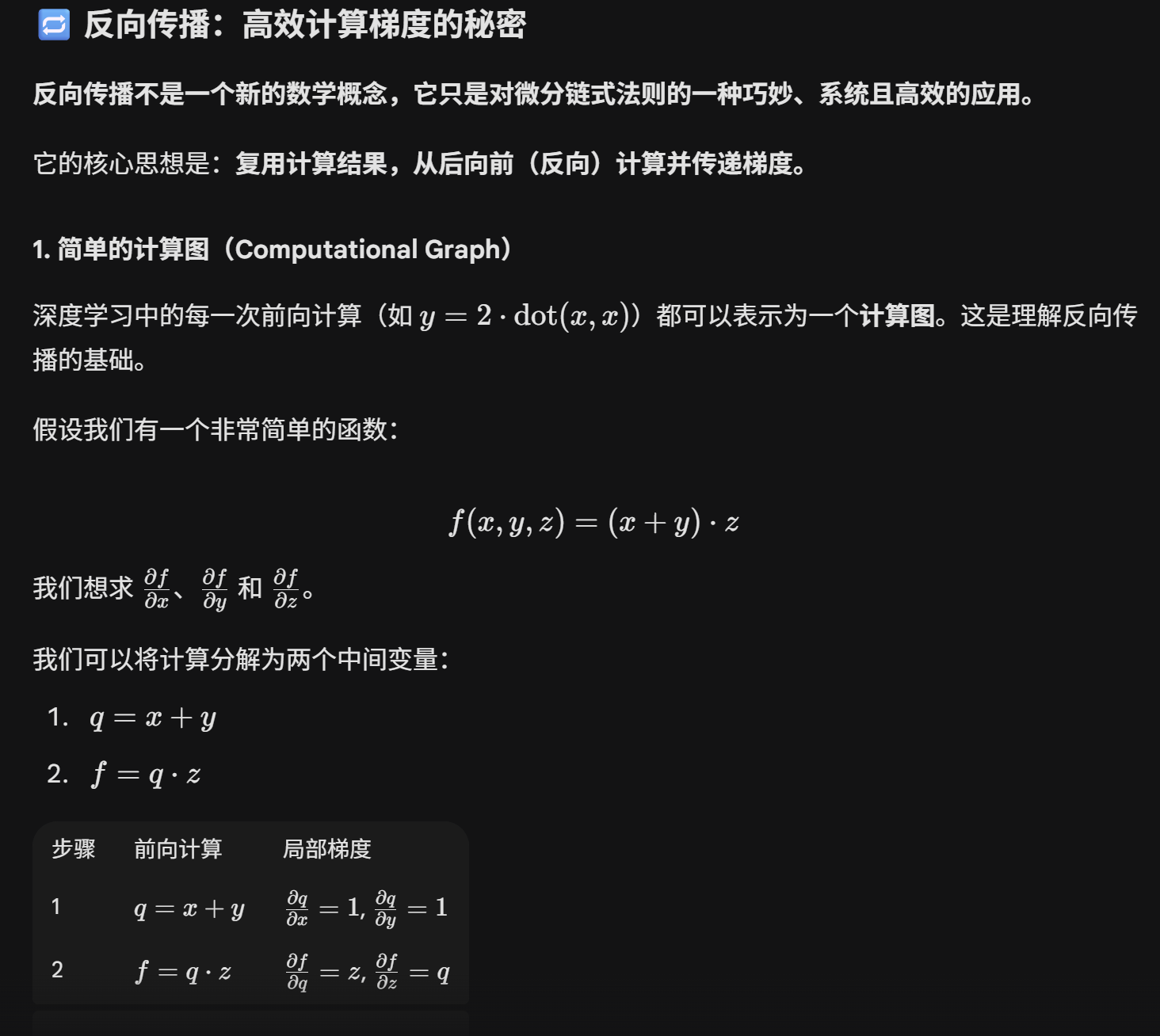

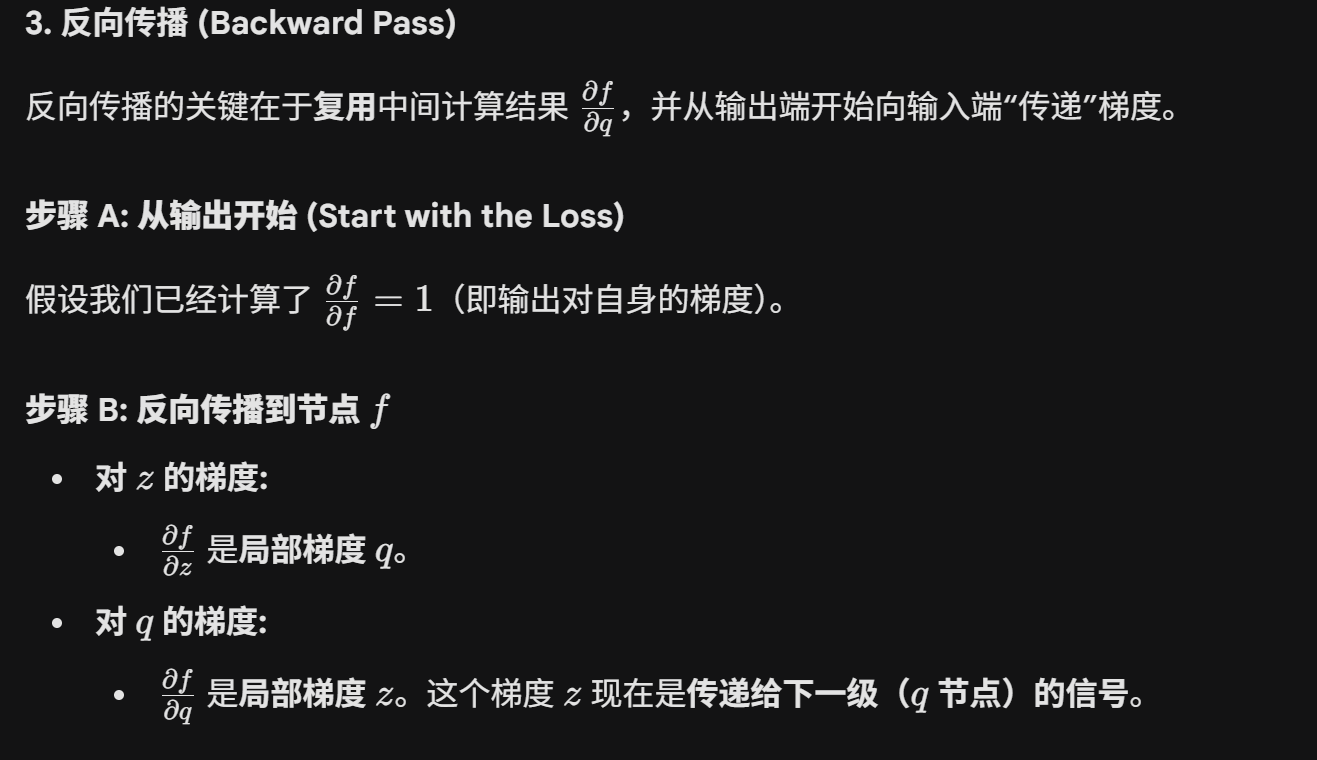

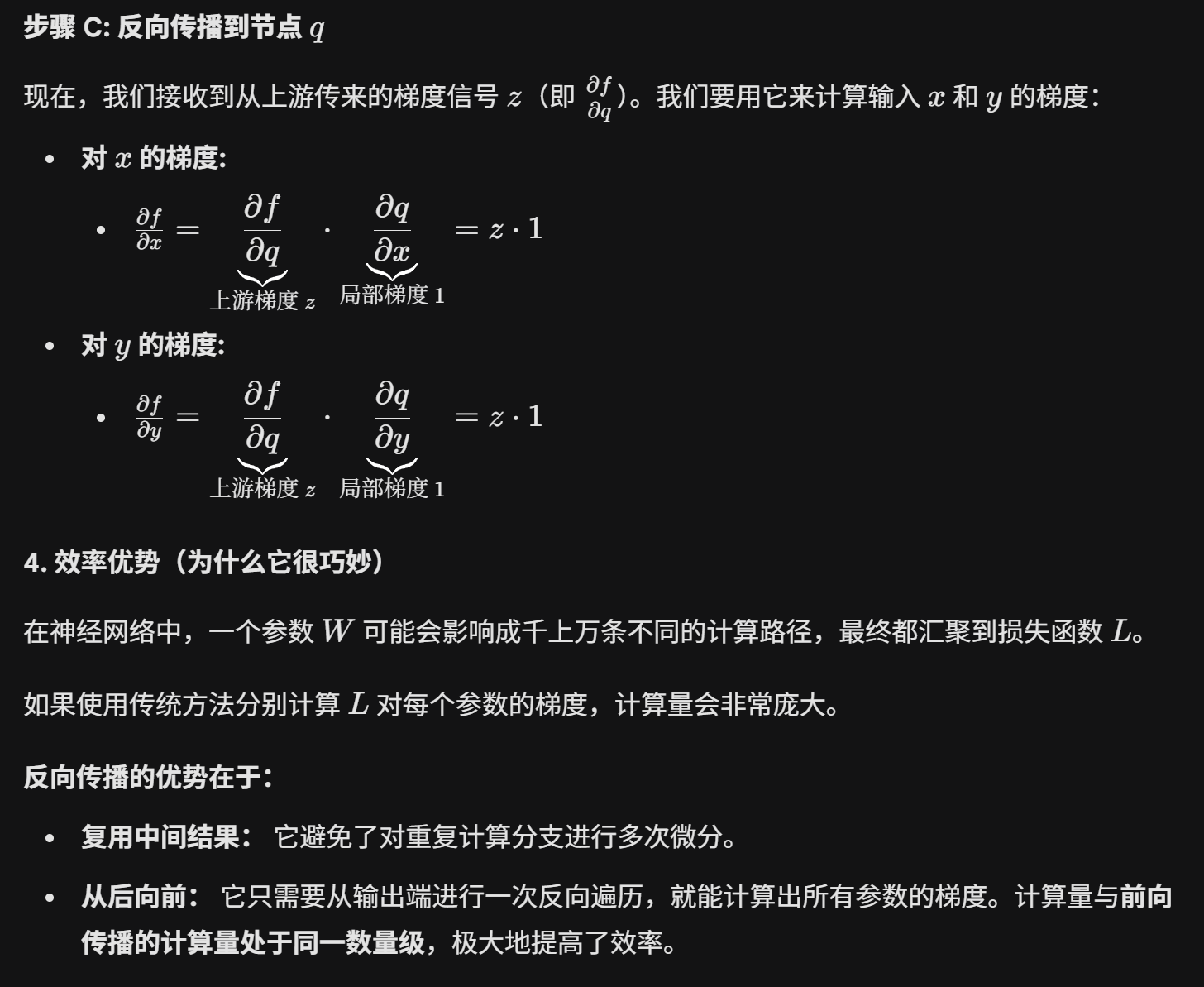

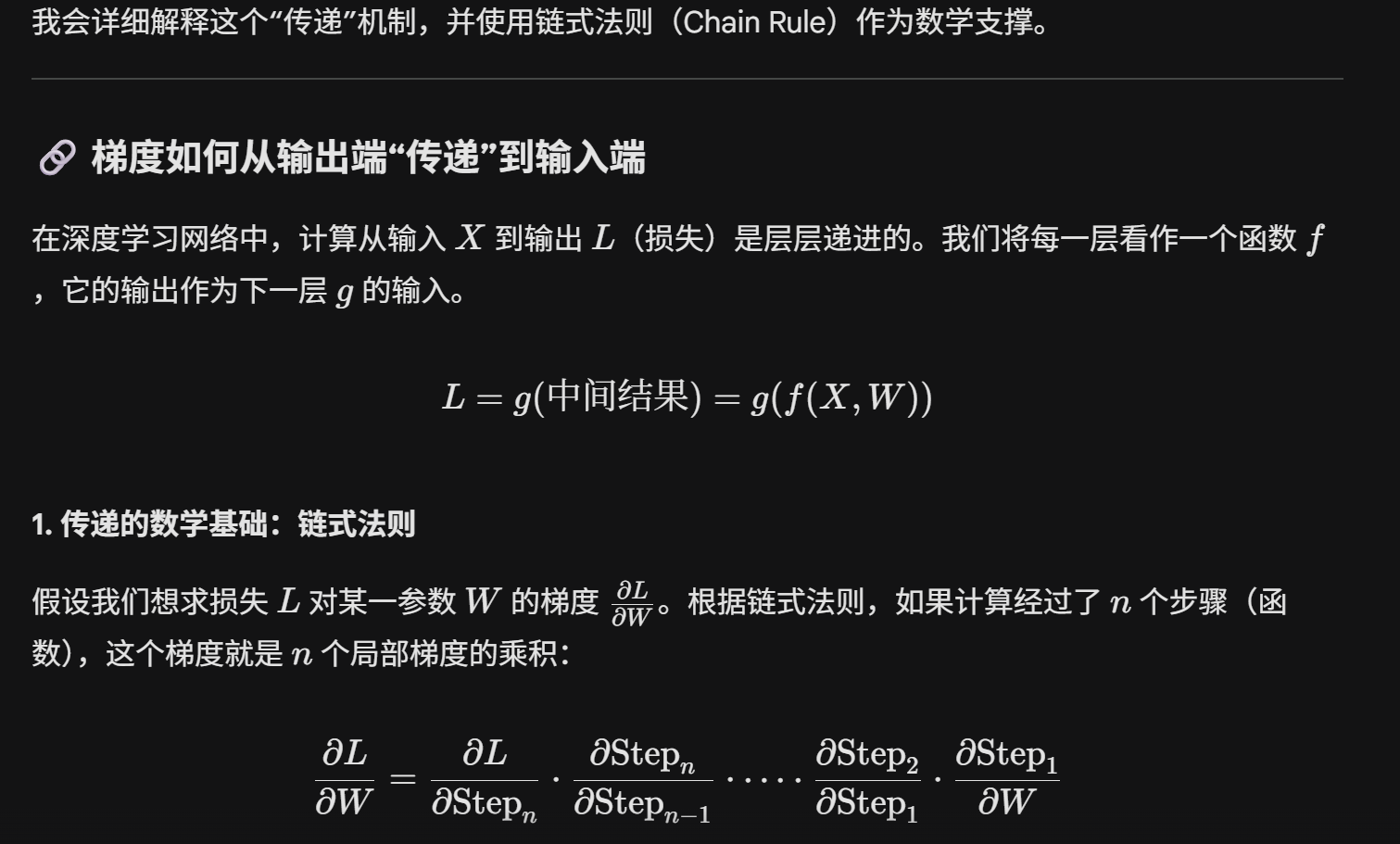

下面我们可以开始看一下反向传播,反向传播本身是计算梯度的一个算法

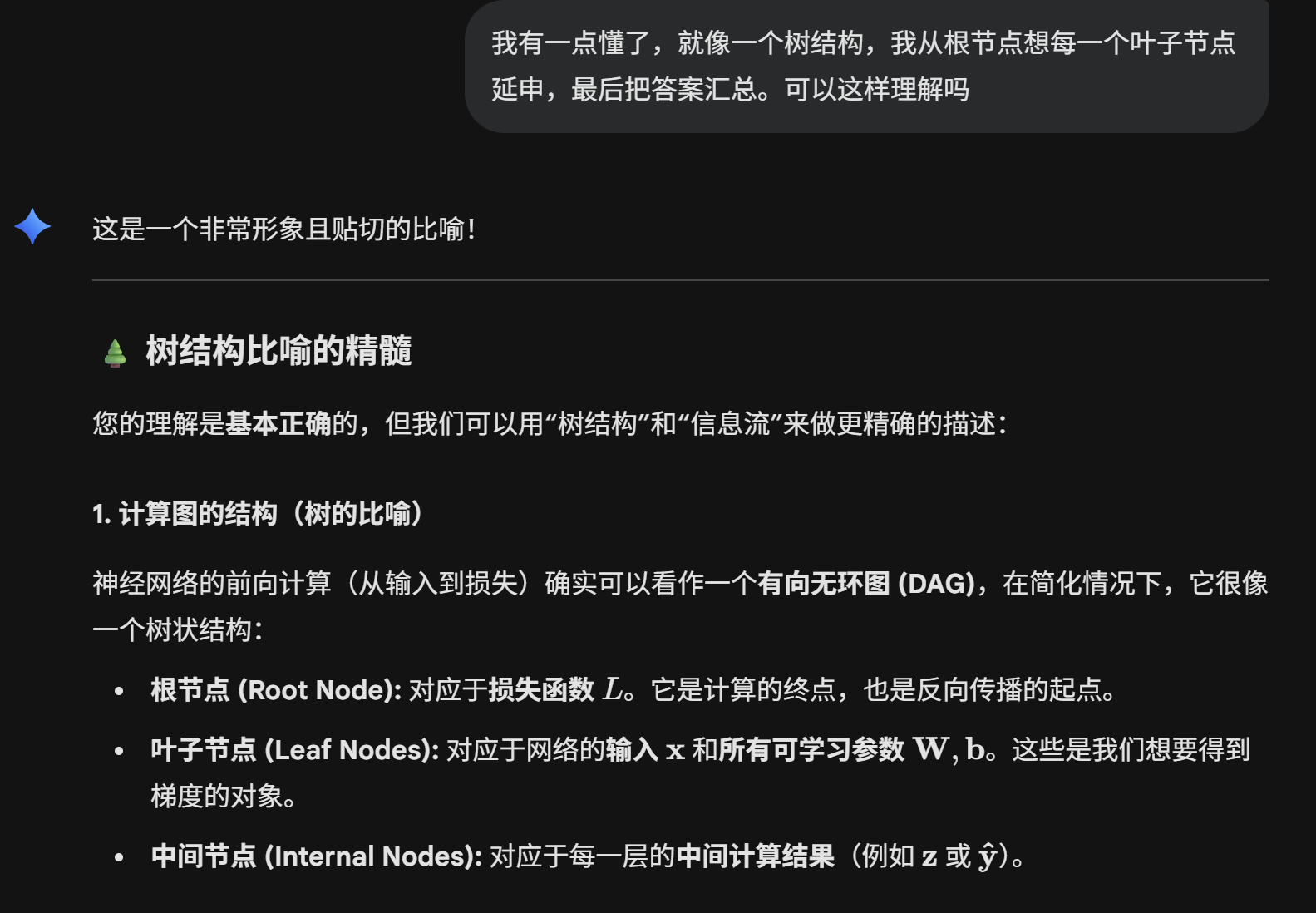

上面说的是具体的实现,当然理解上说,反向传播比较像一个递归结构,也就是我下面的一些理解

也就是说,对于一个复合的复杂结构函数,我们像剥洋葱一样将其向下分解

反例就是我直接用变量参数去对函数偏导,这样不仅麻烦,再参数很多的时候会有计算浪费(因为很多的式子对于不同参数的偏导可能是一样的)

- Title: Notes on Section 2.5

- Author: bobown_yao

- Created at : 2025-11-26 00:00:00

- Updated at : 2026-01-19 13:37:12

- Link: https://bobownyao.github.io/2025/11/26/Notes-on-Section-2-5/

- License: All Rights Reserved © bobown_yao