Notes on Section 5.6

此时此刻,作者的laptop上既没有一个gpu,也没有两个gpu,于是本章如此潦草作罢

这一节讲的是GPU在计算上的应用,以及如何优化数据的传递以利用并行运算的优势

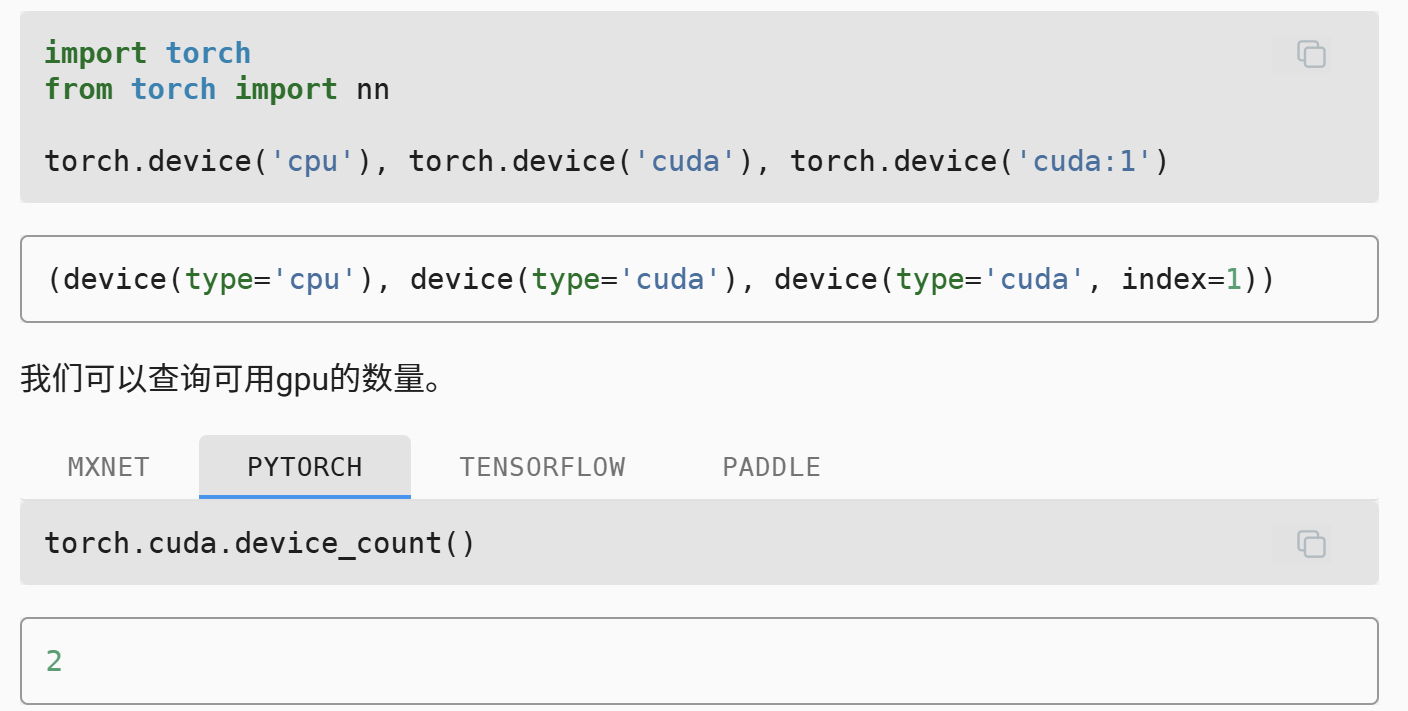

系统创建张量的时候,默认会存储在cpu上,我们可以通过复制传递这个信息

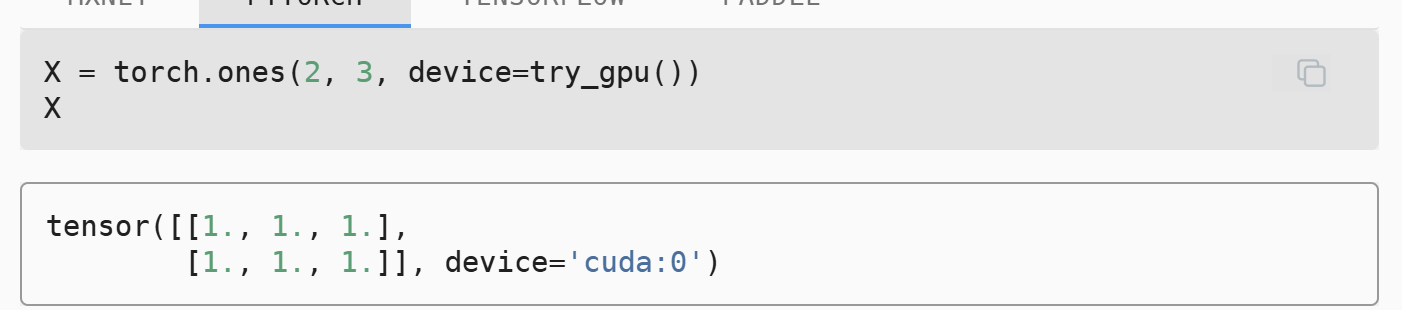

我们可以指定张量创建在gpu上

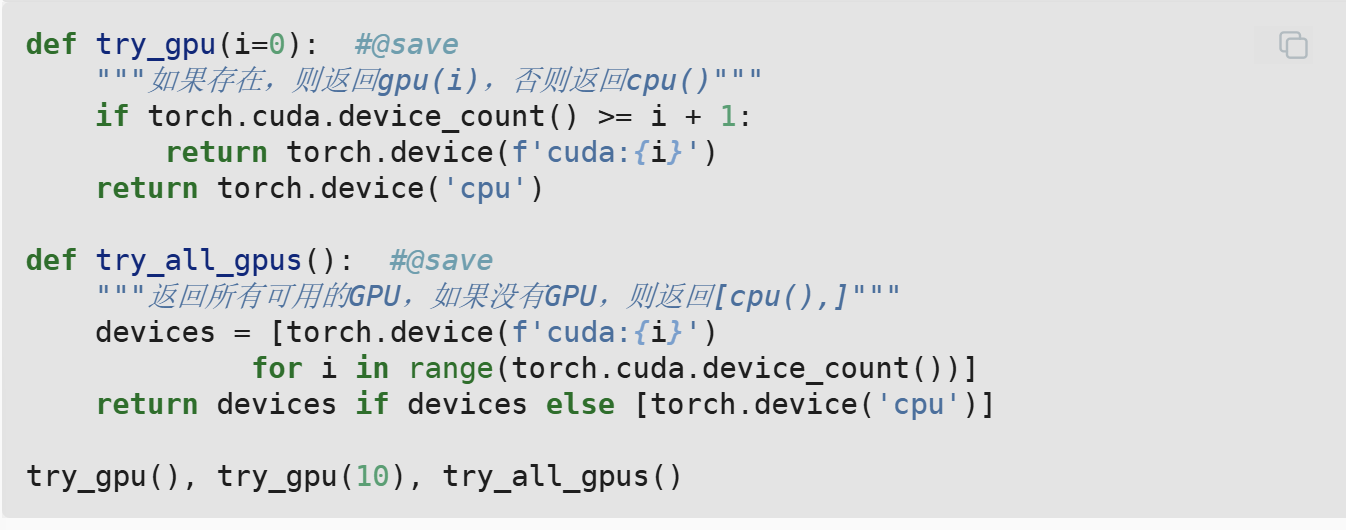

这里的try_gpu主要是为了防止没有gpu(说谁呢)

所以核心其实是在创建的时候传入一个设备参数,这里是torch.device(f’cuda:{i}’)

以下的一些代码可以用于查询现有设备下的gpu数量

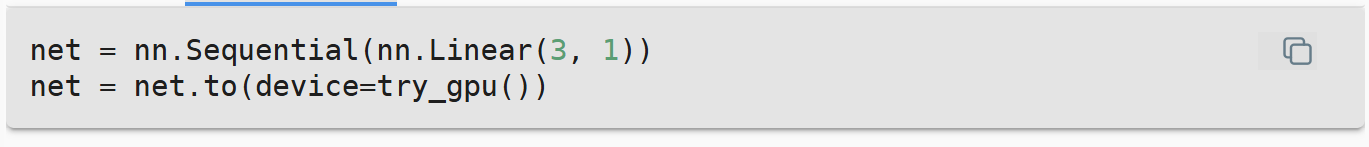

同时神经网络模型也接受不同的设备分配部署

比如这样子可以将我们现在定义的net层部署到gpu

这样的部署会将权重/偏置等一些参数转移到gpu上,cpu仅保留句柄

- Title: Notes on Section 5.6

- Author: bobown_yao

- Created at : 2026-01-06 00:00:00

- Updated at : 2026-01-17 16:19:05

- Link: https://bobownyao.github.io/2026/01/06/Notes-on-Section-5-6/

- License: All Rights Reserved © bobown_yao