Notes on Section 6.1

这一节开始将进入卷积层的一些相关知识

“我们之前讨论的多层感知机十分适合处理表格数据,其中行对应样本,列对应特征。 对于表格数据,我们寻找的模式可能涉及特征之间的交互,但是我们不能预先假设任何与特征交互相关的先验结构。 此时,多层感知机可能是最好的选择,然而对于高维感知数据,这种缺少结构的网络可能会变得不实用。”

这里的不实用,主要指的是稠密层不引入任何的先验,也就是其会尝试任意两个特征之间的关系,不管其在空间上相距多远。在表格中这是有意义的,因为表格的空间结构并不代表其中任意两个特征之间是否存在强力的连接。但是在图像的二维处理中,最左上角的像素和最左下角的像素对于整个图像的含义的整体性关联可能就没有这么强了。

所以说全连接层训练模型的弊端就是其可能相对依赖其中某一些特征,而不是特征之间的关系,如果这个特征改变了,那么模型就可能给出错误的回答

另一个问题是对于二维的图像数据,参数量是平方增长的,这使得使用该模型对大图像的识别变得不太可能

卷积神经网络(convolutional neural networks,CNN)是机器学习利用自然图像中一些已知结构的创造性方法

对于人来说,如果在已有的黑白图中拆掉一整根线,这个图可能就无法被正常识别了,但是随机的将10%的黑色像素涂白,这个图也许还可以识别的比较好。所以说我们这里可以同样的向模型引入这种先验——空间不变性(无论哪种方法找到这个物体,都应该和物体的位置无关)

接下来我们进入数学的表达部分

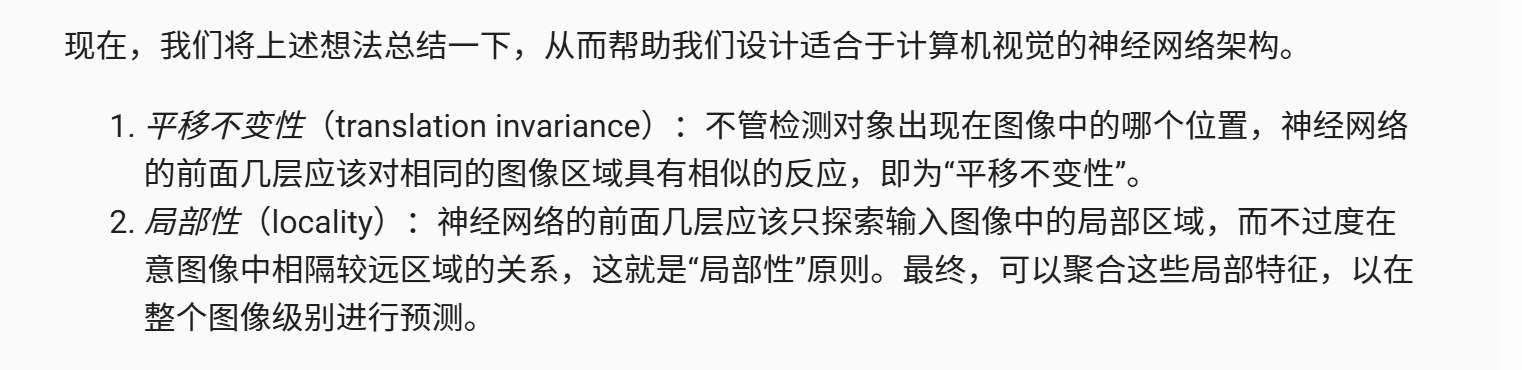

H_ij对应输出像素,X_ij对应输入像素,W是一个四维张量,把每个输入输出一一对应(这里的输入和输出预设形状一样)

我们只需重新索引下标,使k=i+a, l=j+b,这时a,b就变成了相对位置(i,j)

(这里的a,b可以正偏移或者负偏移,使得其效果和原先的k,l相同,我们也可以理解为是对于i,j偏移的补偿)

这里我们为了比较方便的记录相对位移,允许V的负下标

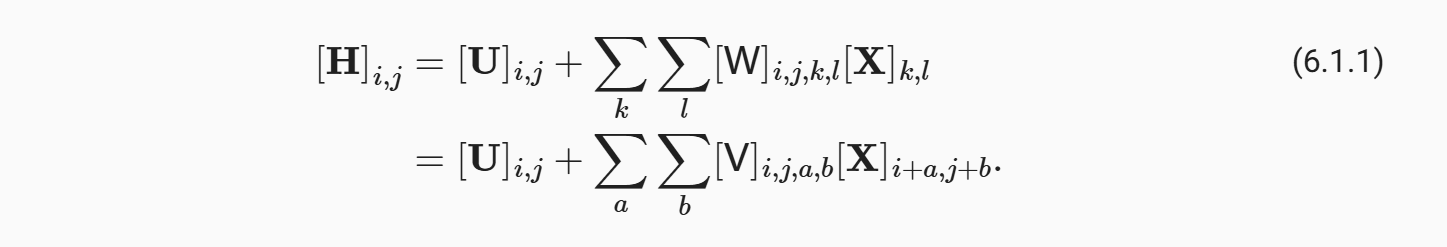

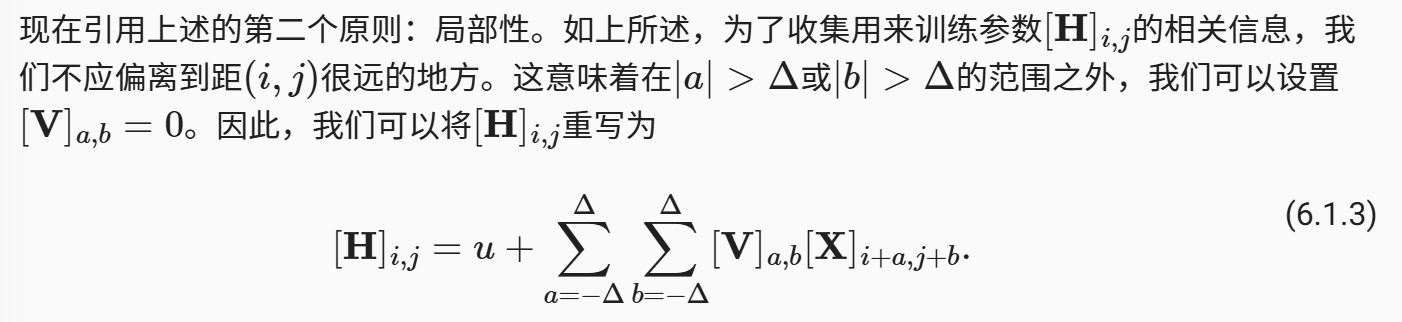

我们现在应用我们刚刚总结的平移不变性

这里可以去掉u,V的关于i,j的下标指示,正是因为我们觉得这个部分的特征值是和位置无关的,也就是说H_ij不应该被其坐标位置的参数影响

这就是卷积!(狗头)

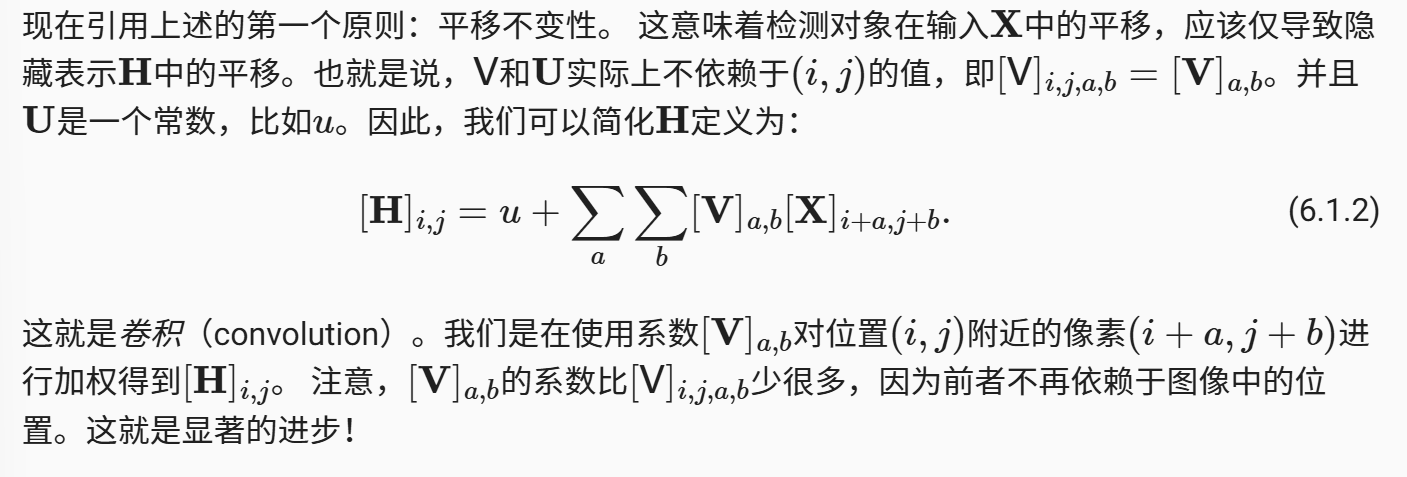

Ok我们现在应该开始运用我们刚刚得到的另一个特质了,也就是局限性

这里我们认为,只研究该像素周围的 (delta*2+1)^2的部分就ok了,这是因为我们认为相关信息是存在有效距离的

“在深度学习研究社区中,被称为V卷积核(convolution kernel)或者滤波器(filter),亦或简单地称之为该卷积层的权重,通常该权重是可学习的参数”

卷积层极大的简化了参数的开销,但是也带来了一些问题

当出现特定符号需要出现在特定位置的时候,这种判断就会失效,比如说想训练一个观测表格打勾的模型,勾出现在正确框和错误框的语义是完全相反的,但是由于卷积层只关注局部形态,其可能没有办法处理这种情境。

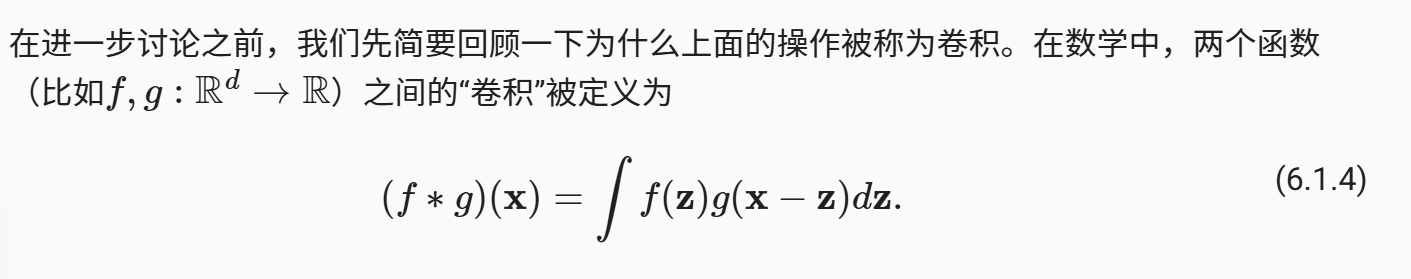

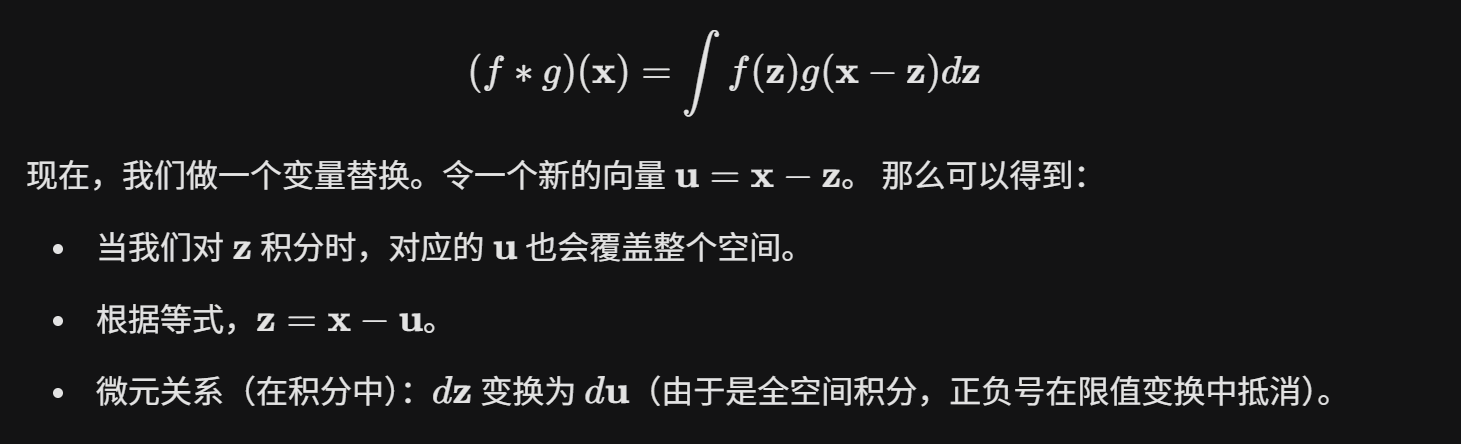

在数学上我们这样定义一个卷积操作,在这个算子中,f,g是两个函数,x是输入(也可以认为是在指定位置),然后我们在空间中遍历z,积分f(z)和g(x-z),其中x-z就是当前遍历到的z和我们指定位置x的相对位置,z+x-z=x,即我们用这个位置修正代入g作为 f(z)的权重

这里我们会发现数学上的卷积是有互换性的

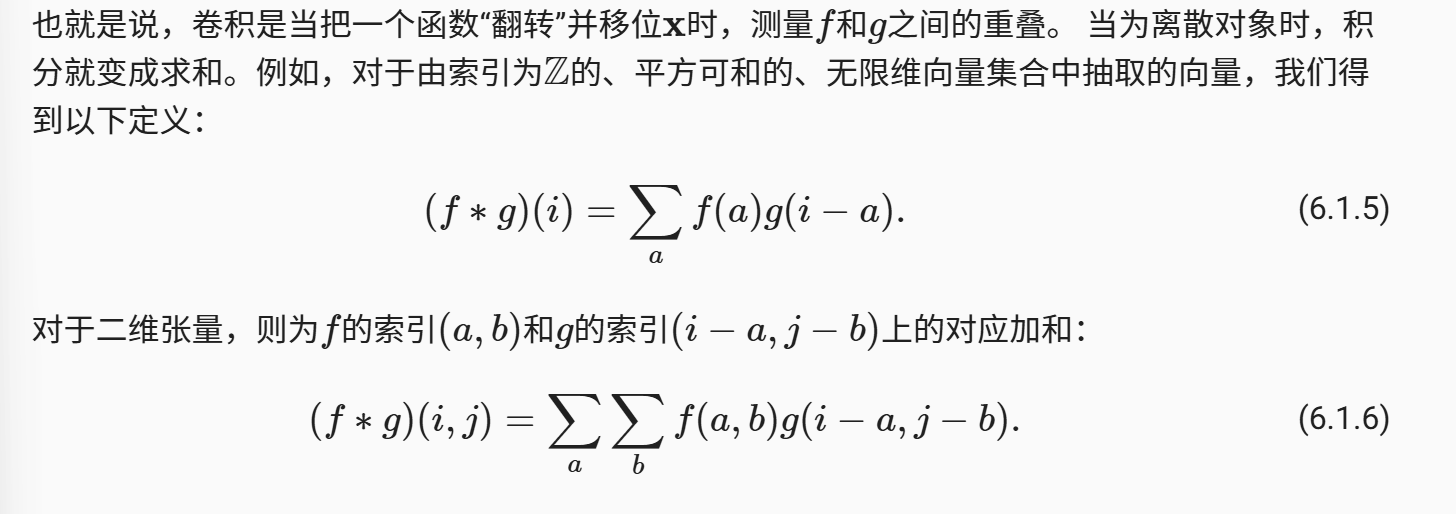

在模型中,我们对卷积离散化处理

通过比对,我们可以发现6.1.6和6.1.3其实是等效的

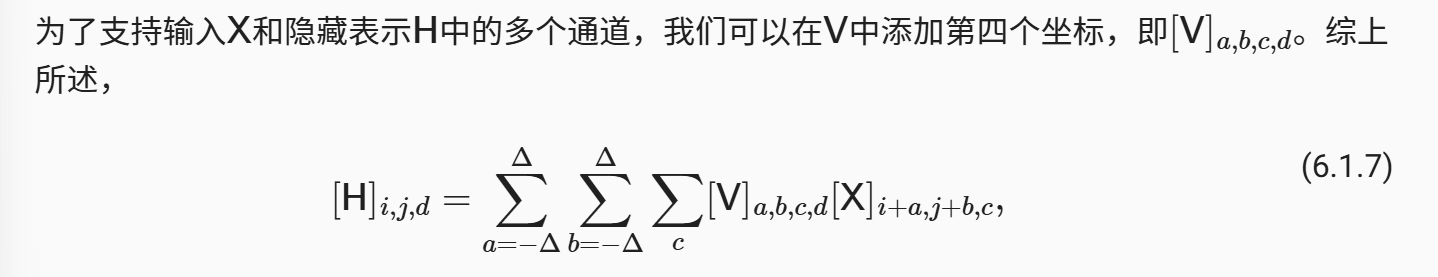

不过,在处理图像的时候,除了图像的位置信息,我们往往还会有颜色相关的通道强度信息,比如说三个通道/三种原色(红色、绿色和蓝色),这时候我们的数据解构就发生了变化

实际上一个像素就被三分成了三个有独立强度的值。比如一个1024*1024*3的结构,这时候我们需要改写一下卷积的表示方式

这里新增了c,d分别用于连接输入的通道和输出的通道,这个部分中,层内的通道是全连接的,也就是说,每一个输入的通道值都会影响每一个输出的通道值,这也是为什么我们同时增加了c,d两个变量

我们观测这样一个问题

这里说的就是每个通道的采样都是独立的,然后内部通道是全连接的形式

- Title: Notes on Section 6.1

- Author: bobown_yao

- Created at : 2026-01-06 00:00:00

- Updated at : 2026-01-17 16:19:05

- Link: https://bobownyao.github.io/2026/01/06/Notes-on-Section-6-1/

- License: All Rights Reserved © bobown_yao