Notes on Section 7.2

上一节我们讨论了AlexNet的构成和局限性,并且AlexNet并没有提供一个模板化的神经网络搭建流程。这部分的VGG和其相关组件提供了一些启发式的意见

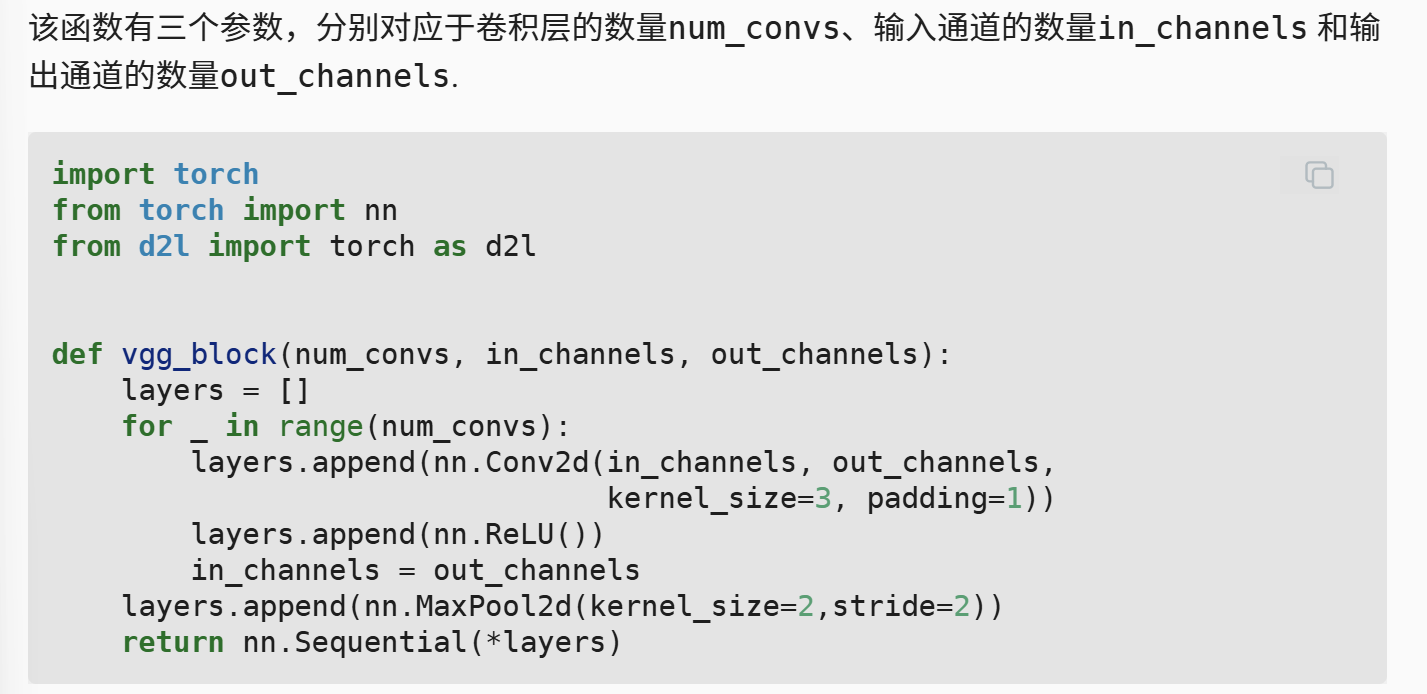

经典卷积神经网络的基本组成部分是下面的这个序列:

1. 带填充以保持分辨率的卷积层

2. 非线性激活函数,如ReLU

3. 池化层

VGG块的结构如下

我们可以发现,这个块的逻辑就是,第一个卷积层先放缩通道数量,多个卷积层放大感受野,穿插ReLU,最后池化下采样。

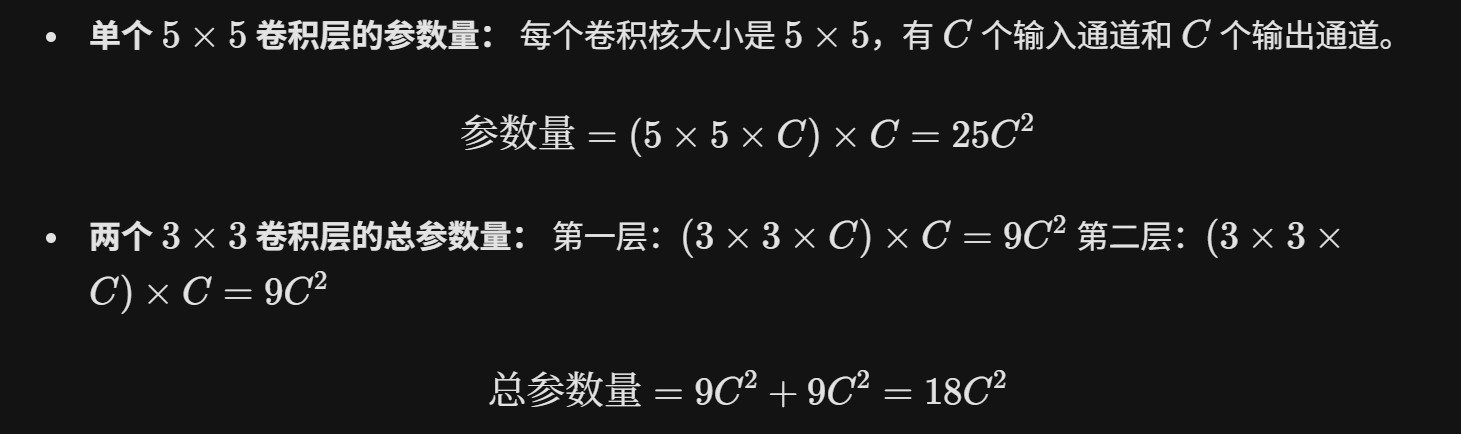

VGG中提出,两个3*3的卷积层的叠加,在减少参数的同时具有和5*5卷积层相同的感受野。关于单个像素点的计算参数量如下

一个是平方,一个是线性增长,这个应该在感受野更大的时候区别更显著

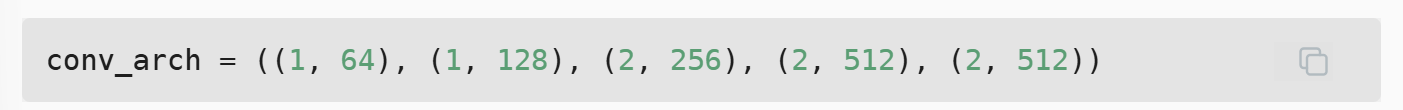

Conv_arch作为超参数,记录了每一个VGG块的卷积层数量/输出通道数

这里达到的感受野大约是120*120(考虑池化层的等价缩放)

这个感受野可以在224*224的图像中捕捉到我们需要的整体特征,那么也就达到了我们的期望功能

- Title: Notes on Section 7.2

- Author: bobown_yao

- Created at : 2026-01-17 00:00:00

- Updated at : 2026-03-08 19:46:44

- Link: https://bobownyao.github.io/2026/01/17/Notes-on-Section-7-2/

- License: All Rights Reserved © bobown_yao