Notes on Section 8.4

隐状态的计算从结构上看是一个2to1的映射

我们先来看一个不包含隐藏态的,只含有一个隐藏层的多层感知机

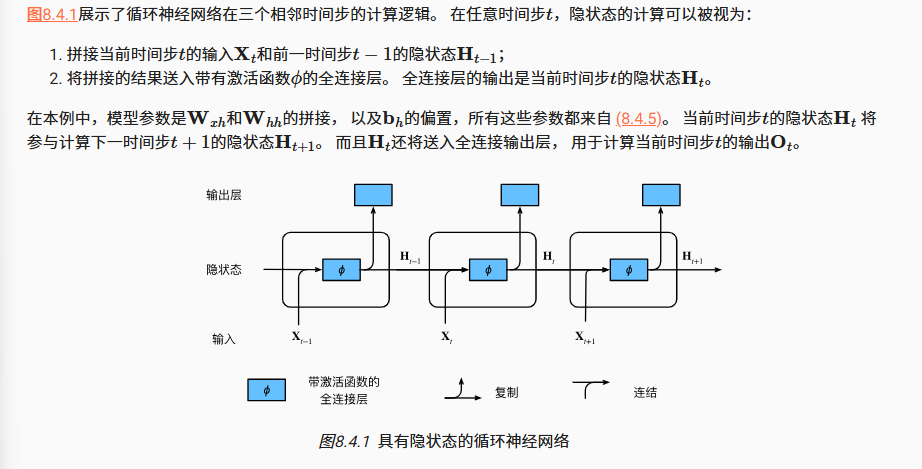

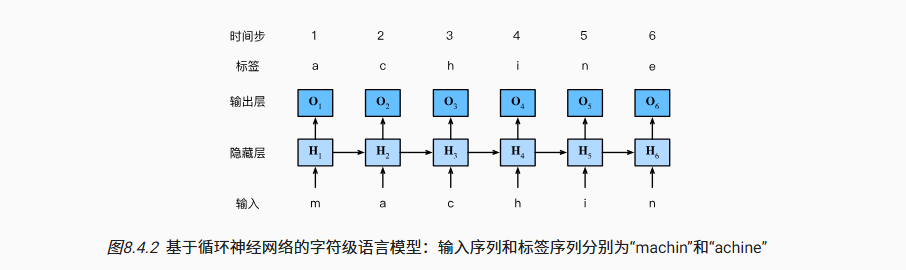

在RNN中,我们增加了隐藏量

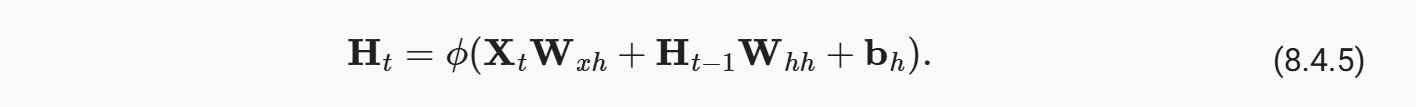

“由于在当前时间步中, 隐状态使用的定义与前一个时间步中使用的定义相同, 因此(8.4.5)*的计算是循环的(recurrent)。 于是基于循环计算的隐状态神经网络被命名为 循环神经网络(recurrent neural network)。 在循环神经网络中执行(8.4.5)*计算的层 称为循环层*(recurrent layer)。”*

因为矩阵分块乘法的性质,我们可以将H和X合并之后和权重做乘法,结果相同但是可以减少计算开销

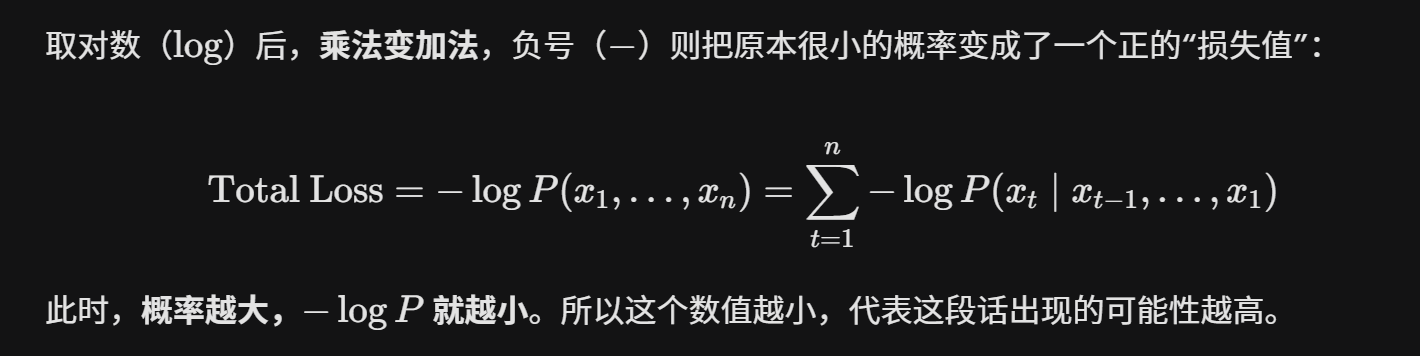

“在训练过程中,我们对每个时间步的输出层的输出进行softmax操作, 然后利用交叉熵损失计算模型输出和标签之间的误差。 ”

这里有几个映射关系

语素->索引(固定映射,双射)

索引(转换为独热编码)->向量化(也就是输入的X的形状,本质上是把独热编码压缩重组映射到一个较为稠密的空间中,这个映射是训练的,通过X传回的梯度,用于理解)

前序状态->当前状态(H相关,也是累计整个时间步后更新)

当前状态->输出预测(O相关,给Loss)

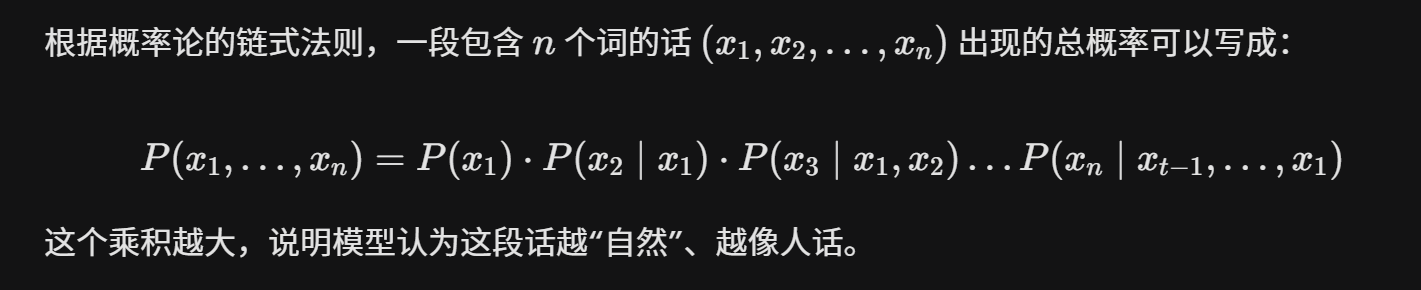

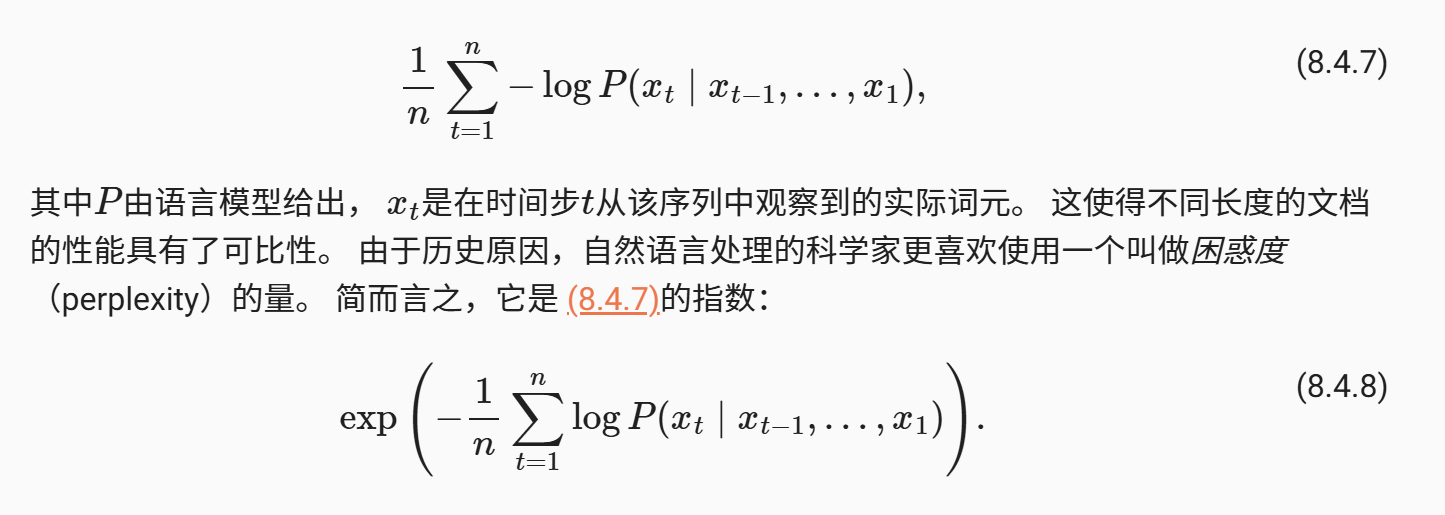

在代码实现前,还有一个话题是关于困惑度(Perplexity)

我们通过取平均值来抵消长文本相对于短文本的劣质(毕竟小数相乘有累积效应)

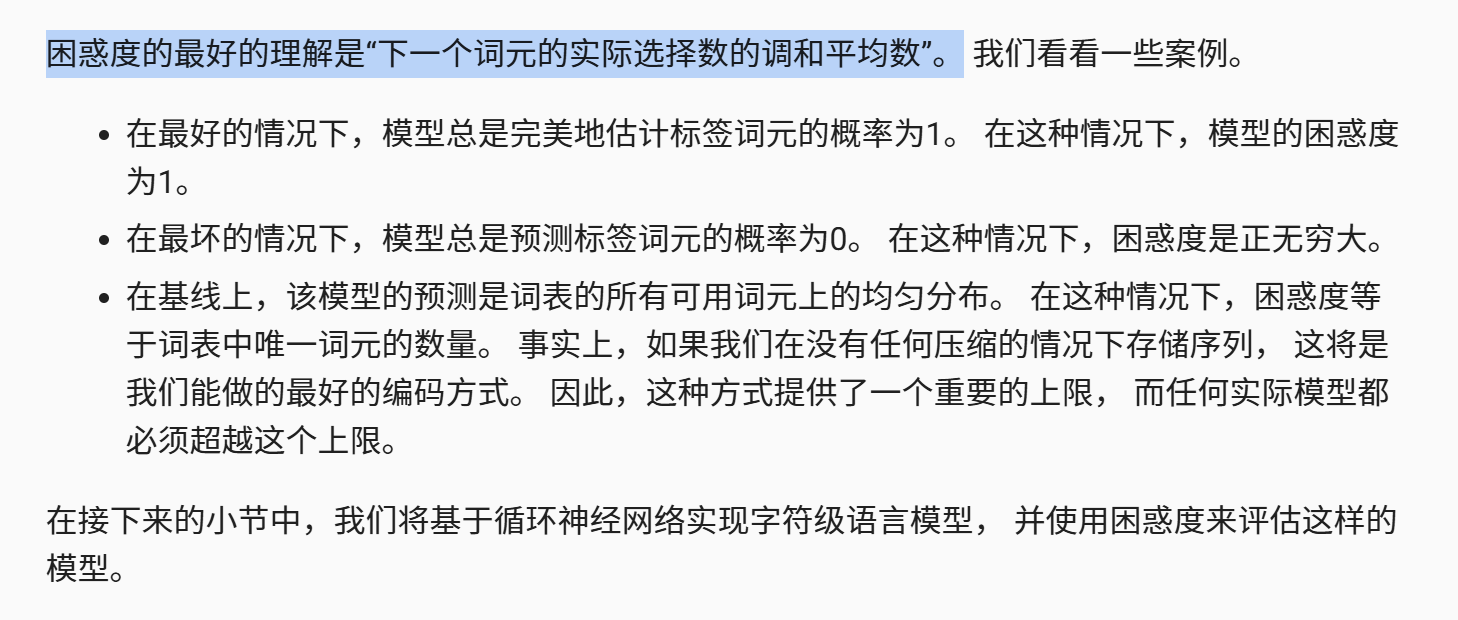

“困惑度的最好的理解是“下一个词元的实际选择数的调和平均数”。

- Title: Notes on Section 8.4

- Author: bobown_yao

- Created at : 2026-02-12 00:00:00

- Updated at : 2026-03-08 19:46:44

- Link: https://bobownyao.github.io/2026/02/12/Notes-on-Section-8-4/

- License: All Rights Reserved © bobown_yao